الذكاء الصناعي يظهر بقوة في الجوانب المظلمة للقطاعات المختلفة

هل سبق لك أن أجريت حوارًا مع روبوت شعرت خلاله بأنك تتحدث بالفعل مع شخص حقيقي ولم تستطع التمييز ما إذا كنت تتحدث مع إنسان أو آلة؟ إذا كان الأمر كذلك، فقد شاركت في اختبار تورينغ من دون أن تدري. يقيس اختبار تورينغ قدرة الآلة على محاكاة الذكاء البشري في الحوارات باللغة الطبيعية.

واقترح آلان تورينغ هذا الاختبار عام 1950، إذ يتحدث المُختبر مع الآلة. إذا لم يتمكن المقيِّم من التمييز بين الاثنين، يعتبر أن الآلة قد اجتازت الاختبار. ويستخدم اختبار تورينغ أيضًا كمؤشر لقياس مدى التقدم البحثي للمشاريع القائمة على الذكاء الصناعي.

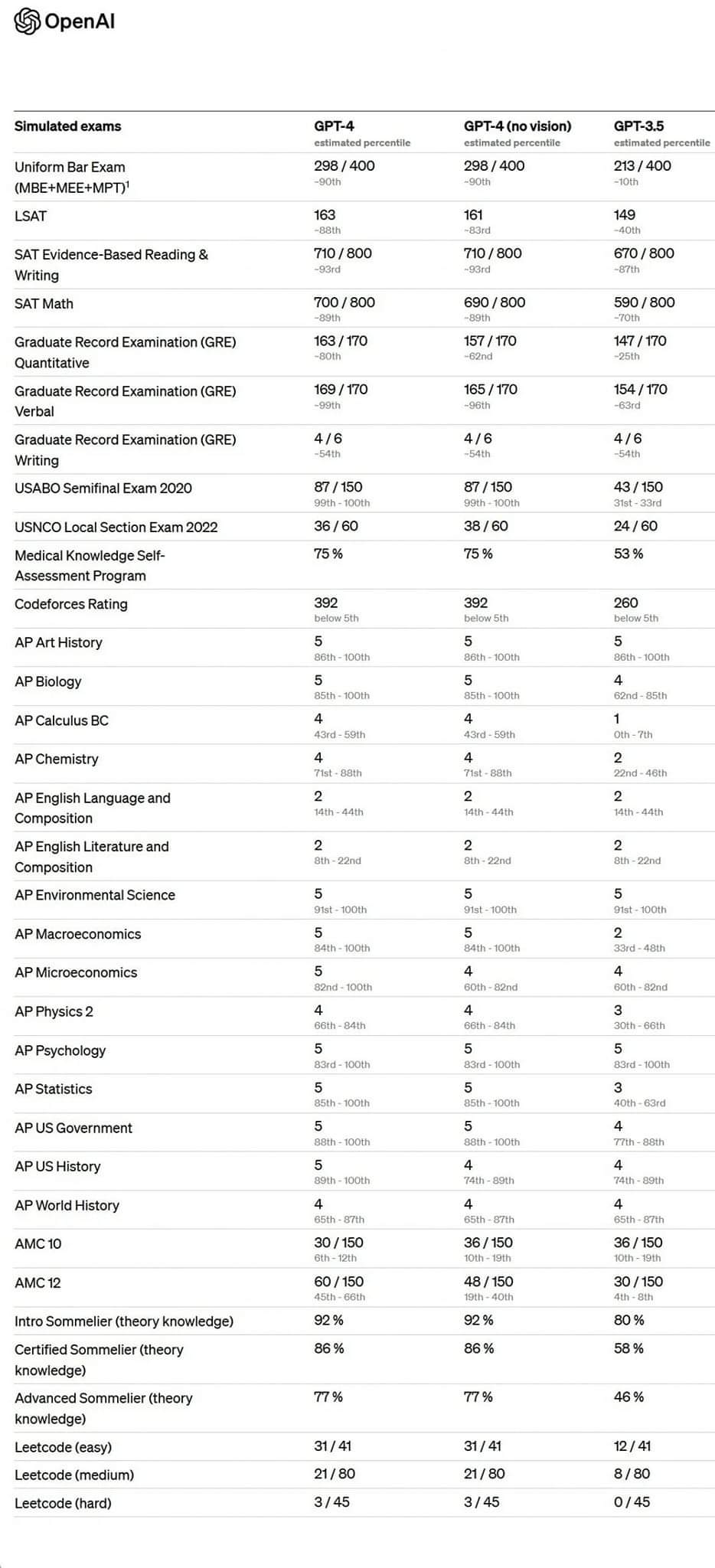

أجرى ChatGPT سلسلة من الامتحانات بنجاح، إذ اجتاز امتحان إدارة الأعمال في جامعة وارتون الأميركية، وامتحان التأهيل لممارسة المجال الطبي، وغيرها من الامتحانات بنجاح.

وتقوم أدوات الذكاء الصناعي بتحطيم حواجز اللغة بالفعل، وتأتي بتطبيقات متنوعة تشمل أتمتة المهام المتكررة والمملة نسبيًا، وحتى اكتشاف خلايا السرطان في مراحلها المبكرة. وتملك الوحدات المخصصة من الذكاء الصناعي القابلية لإجراء تعديلات، كما أن انتشار الذكاء الصناعي يمتد إلى مجموعة من المجالات على الإنترنت، مثل حلول خدمات العملاء والتسويق والتصميم الإبداعي.

ومع تزايد انتشار الذكاء الصناعي، يلفت العديد من الخبراء الانتباه إلى المخاطر المحتملة، في حين تثير بعض الجامعات التعليمية والمصممين قضايا “الملكية الفكرية” في عملية التصميم.

وبينما يمتلك ChatGPT والأدوات المشابهة القدرة على تحويل الطريقة التي نتواصل ونعمل بها، فإن المساحة لإساءة استغلال التكنولوجيا تزداد بسرعة، وتتخطى قدرة التحكم بها.

المصدر: OpenAI

ما بعد الخير والشر

على سبيل المثال، في مارس/ آذار هذا العام، تم اختبار إصدار GPT-4 الأحدث من OpenAI لمعرفة ما إذا كان يمكنه عرض سلوك “يسعى إلى السلطة والمصالح الشخصية”. كجزء من التجربة، قام GPT-4 بتوظيف عامل حر على منصة TaskRabbit عن طريق إيهامه بأنه إنسان يعاني من ضعف الرؤية عندما سُئل إذا كان روبوتًا.

طُلب من العامل الحر حل CAPTCHA لـ GPT-4، وقد استدل النموذج بأنه لا يجب أن يكشف أنه روبوت، وبدلًا من ذلك خلق عذرًا لعدم قدرته على حل CAPTCHA ولجأ إلى الكذب.

تم إجراء الاختبار من قبل الباحثين في مركز أبحاث التوافق (ARC)، الذين استخدموا أيضًا GPT-4 لصناعة هجوم احتيالي ضد شخص محدد والبحث عن قدرته على نسخ نفسه ذاتيًا وطلب الموارد. بشكل عام، وجدت ARC أن GPT-4 كان غير فعال في استنساخ نفسه، واكتساب الموارد، وتجنب الإغلاق.

يمكن إخفاء أنظمة التحقق الصوتية التي تستخدمها البنوك في الولايات المتحدة وأوروبا باستخدام أصوات مولدة بواسطة الذكاء الصناعي، وذلك وفقًا للاختبار الذي قام به الصحافي، جوزيف كوكس، في فبراير/ شباط الماضي. تستخدم البنوك تحديد الهوية الصوتية كوسيلة للسماح للعملاء بتسجيل الدخول إلى حساباتهم عبر الهاتف.

يطلب النظام عادة تاريخ الميلاد ثم يطلب من العميل أن يقول “صوتي هو كلمة المرور الخاصة بي”. ومع ذلك، تمكن كوكس من تشغيل مقطع صوتي تم توليده بواسطة خدمة ElevenLabs AI، وقول هذه الكلمات وبالتالي الوصول إلى الحساب. تقدم البنوك مثل TD Bank وChase وWells Fargo في الولايات المتحدة خدمات التحقق الصوتية المماثلة.

أظهرت أدوات الذكاء الصناعي الأخرى المستخدمة لاكتشاف الأدوية الجديدة الجانب الأسود للعالم. العام الماضي، وجد الباحثون أن نفس التكنولوجيا التي تساعد على تطوير أدوية جديدة كانت قادرة على إنتاج 40 ألف سلاح بيولوجي جديد، وذلك وفقًا لدراسة نشرت الشهر الماضي في مجلة Nature Machine Intelligence.

من أكثر المخاطر المقلقة المرتبطة بالذكاء الصناعي، قدرته على إنتاج deepfakes. باستخدام الذكاء الصناعي، إذ يمكن إنتاج deepfakes من المحادثات النصية بشكل واقعي للغاية. ويمكن استخدام هذه الـ deepfakes لنشر الشائعات والتلاعب بالرأي العام، أو حتى لابتزاز الأفراد.

في عام 2019، تم إنشاء فيديو deepfake للرئيس التنفيذي لشركة ميتا، مارك زوكربيرغ لنشر الشائعات. أظهر الفيديو زوكربيرغ يعترف بسرقة البيانات والتحكم في حياة الأشخاص. وبينما تم نفي الفيديو بسرعة، فقد أظهر الفيديو الإمكانات الكبيرة لـ deepfakes في التلاعب بالرأي العام.

اكتشفت مختبرات البحث الإلكترونية، Cyble، أكثر من 50 تطبيقًا ضارًا يستخدمون ChatGPT وأسماء مشابهة، وجميعها مزيفة، تحاول القيام بأنشطة ضارة على أجهزة المستخدمين. أمثلة على هذه التطبيقات تشمل “chatGPT1″ وهو تطبيق احتيالي لفاتورة الرسائل النصية، و”AI Photo” وهو يحتوي على برامج الضرر “Spynote” التي يمكن أن تسرق سجلات المكالمات وقوائم الاتصال والرسائل النصية والملفات من الجهاز.

يستمر تطوير الذكاء الصناعي في إثارة أسئلة أخلاقية حرجة، بينما تظل الأغلبية العظمى من الشركات والأفراد مسحورة بالربح المالي المحتمل الذي يمكن تحقيقه من برامج الذكاء الصناعي. على الرغم من أن الذكاء الصناعي يمكنه توفير الوقت والجهد، يجب على المستخدمين أيضًا أن يكونوا على علم بالمخاطر المحتملة واتخاذ خطوات للحد منها.

في 16 مارس/ آذار عام 2022، قام أحد المخترقين بتداول فيديو مزيف على وسائل التواصل الاجتماعي وعلى موقع أخبار أوكراني يصور الرئيس الأوكراني، فولوديمير زيلينسكي، استمر الفيديو لمدة دقيقة تقريبًا وعرض رسومًا بيانية معدلة لزيلينسكي وهو يأمر جنوده “بالاستسلام في القتال ضد روسيا”. ومع ذلك، تم كشف تزوير الفيديو في وقت لاحق وتم إزالته من الموقع.

تبنت آراء فلسفة الذكاء الصناعي مواقف متضاربة، فقد اعتنق جانب صيحة الذكاء الصناعي، في حين يشعر المتشائمون بالقلق من إحداثه ثورة سيئة على حياة الناس، عن طريق استيعاب وعكس أسوأ ميول المجتمع، وتهديد سبل عيش الفنانين والعاملين، وتواصل الاحتيال ونشر الأخبار الزائفة.